技术架构的范式革命

人工智能领域正经历从专用模型向通用大模型的范式转移。基于Transformer架构的预训练模型通过自监督学习机制,在海量无标注数据中捕捉语义特征,其参数规模突破万亿级后展现出惊人的涌现能力。这种能力不仅体现在自然语言处理领域,更通过多模态融合技术延伸至视觉、语音甚至跨模态理解场景。

当前主流大模型采用混合专家系统(MoE)架构,通过动态路由机制将复杂任务分解为多个子网络处理。例如Google的Pathways系统通过异构计算单元实现参数效率提升,Meta的LLaMA-3采用分组查询注意力机制降低计算复杂度。这些技术创新使模型在保持性能的同时,推理成本降低40%以上。

关键技术突破方向

- 长文本处理:通过位置编码优化和注意力机制改进,模型有效上下文窗口从2K tokens扩展至200K tokens,实现完整代码库或学术文献的深度理解

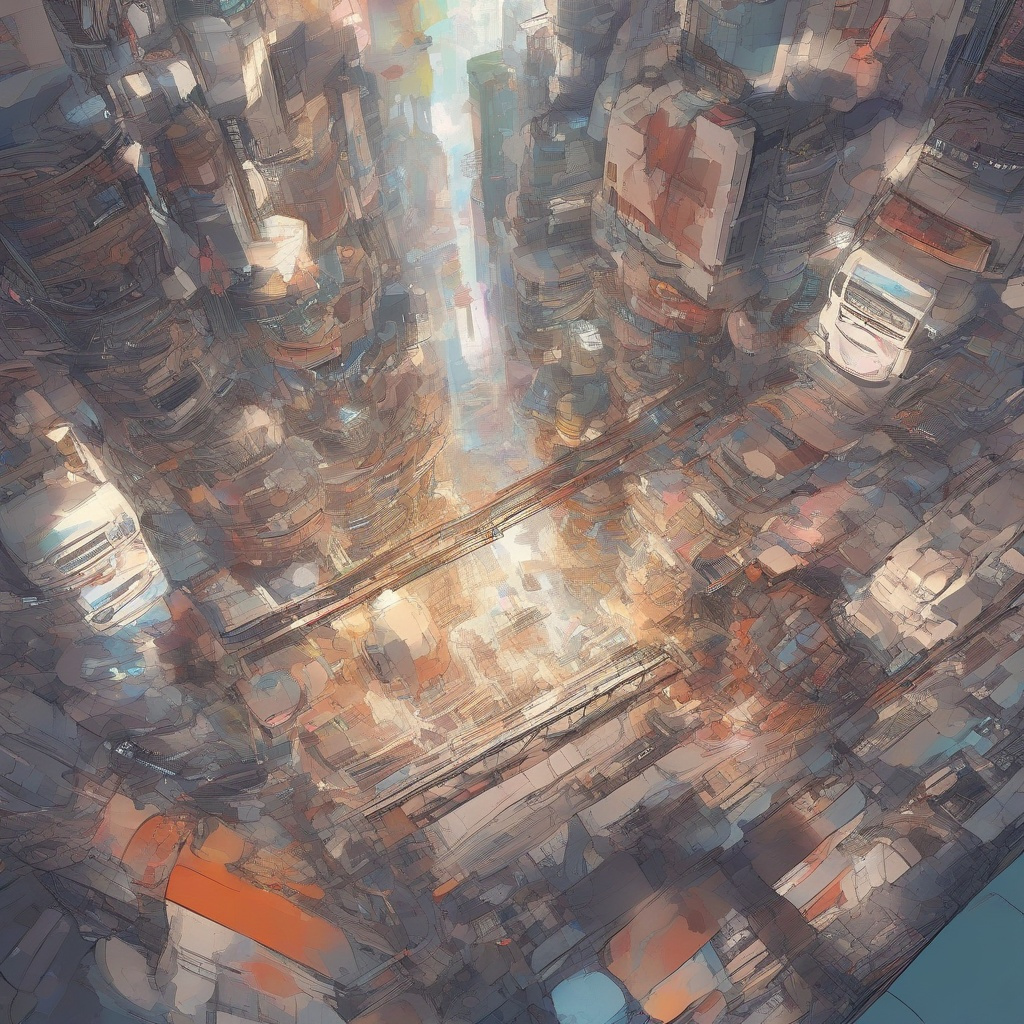

- 多模态对齐:CLIP架构的视觉-语言联合训练方法催生出DALL·E 3、Stable Diffusion XL等生成式模型,实现文本描述与视觉内容的高精度映射

- 强化学习融合:通过引入人类反馈的强化学习(RLHF),模型在医疗诊断、法律咨询等高风险领域展现出更可靠的决策能力

产业应用的深度渗透

在金融领域,智能投顾系统通过整合宏观经济数据、企业财报和社交媒体情绪,构建动态资产配置模型。高盛的Marquee平台已实现80%的常规交易自动化,处理效率提升15倍。保险行业则利用多模态模型实现车损评估的秒级响应,准确率超过资深理赔员。

医疗健康领域出现革命性突破:基于医学知识图谱的诊疗系统可同时处理电子病历、影像数据和基因检测报告。梅奥诊所开发的AI辅助诊断平台,在罕见病识别任务中达到97.6%的准确率,超过人类专家平均水平。药物研发周期从平均5年缩短至18个月,成本降低60%。

典型应用场景分析

- 智能制造:西门子工业大脑通过数字孪生技术,在虚拟环境中模拟10万种生产参数组合,实现产线效率优化12%

- 智慧城市:深圳交通大脑系统整合20万路摄像头数据,通过时空预测模型将拥堵预警时间提前至30分钟,通行效率提升18%

- 教育科技:可汗学院开发的AI导师系统,通过知识状态追踪和个性化学习路径规划,使学生数学成绩平均提升2个标准差

技术挑战与发展趋势

当前面临的核心挑战包括模型可解释性、能源消耗和伦理风险。神经符号系统的研究尝试将符号逻辑引入深度学习框架,在保持性能的同时提升决策透明度。量子计算与神经网络的融合研究显示,特定任务下推理速度可提升3个数量级。

未来三年,行业将呈现三大趋势:一是模型轻量化技术成熟,10亿参数级模型在边缘设备实现实时推理;二是专用芯片架构革新,存算一体技术使能效比提升100倍;三是监管框架完善,欧盟《人工智能法案》和美国《AI权利法案蓝图》将推动技术向可信AI方向演进。